Kommer den kommande DeepSeek V4 att upprepa historien, eller toppa den? DeepSeek chockade en gång AI-branschen genom att bevisa att du inte behöver 100 miljoner USD och ett lager av Nvidia H100 för att bygga en gränsöverskridande LLM som konkurrerar med ChatGPT.

Men efter att hajpen tystnat, är DeepSeek på väg att komma tillbaka med V4. Vi kommer att täcka DeepSeek v4 releasedatum, vad som är nytt och vad du kan förvänta dig, så att du inte missar vart saker är på väg.

Del 1. Vad är DeepSeek?

DeepSeek är ett kinesiskt AI-forskningslabb grundat i Hangzhou, Kina som har tillbringat de senaste åren med att utmana AI-jättar som OpenAI:s ChatGPT. Den bygger och släpper stora språkmodeller (LLM) under öppen källkodslicenser, och det som hela tiden vrider på sig är hur mycket det levererar för hur lite det kostar att köra.

Företaget skapade globala rubriker i början av 2025 när det släppte DeepSeek R1, en resonemangsmodell som matchade OpenAI:s o1 på matematiska och kodningsriktmärken, enligt uppgift för cirka 6 miljoner dollar att träna. Som referens uppskattades GPT-4 ha kostat över 100 miljoner dollar att träna. Den nyheten tog bort 600 miljarder dollar från NVIDIAs börsvärde på en enda dag.

Trots den explosiva starten avtog DeepSeek AI:s fart under året. Dess andel av marknaden för öppen källkod sjönk från cirka 50 % i början av 2025 till under 25 % vid årets slut. Den förlorade hälften av sin marknadsposition på tolv månader.

Nuvarande version och den kommande V4-modellen

Eftersom konkurrenterna kom ikapp snabbt kom de tillbaka i december 2025 med två nya modeller under DeepSeek V3: DeepSeek-V3.2 och DeepSeek-V3.2-Speciale , båda tillgängliga gratis på webben, appar och API.

Nu ska DeepSeek enligt uppgift förbereda sig för DeepSeek V4. Det förväntas ta itu med de svaga punkterna i tidigare versioner och områden där DeepSeek klart har släpat efter multimodala konkurrenter, såsom bearbetning av visuellt innehåll , AI-sökning , ochlångkontextminne .

Del 2. Utgivningsdatum för DeepSeek V4 och vad vi vet hittills

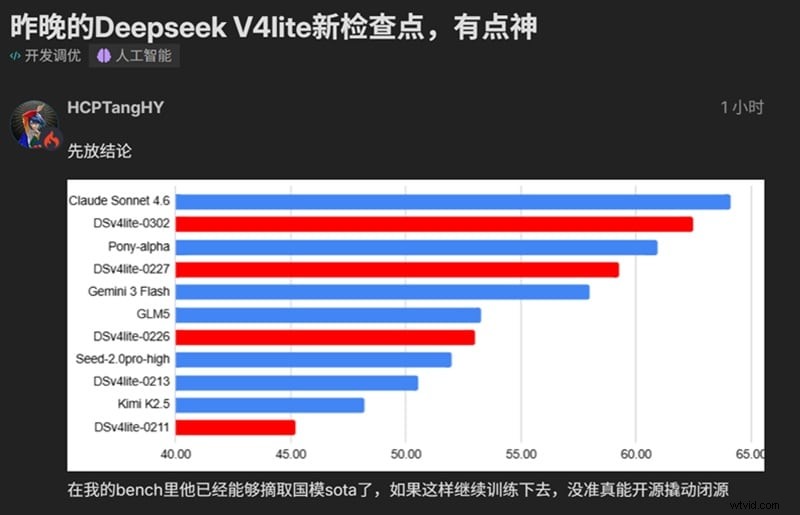

Medan många har väntat har DeepSeek V4 releasedatum inte bekräftats av företaget självt. I början av mars dök DeepSeek V4 Lite kort upp på plattformen, vilket gav ännu större förväntan. Vissa rapporter och tidiga diskussioner tyder på att det kan komma så tidigt som i april 2026.

Det finns dock läckta detaljer om arkitekturen och interna riktmärken som ger en tydligare bild av vad V4 faktiskt byggs för att göra:

- Kodning: DeepSeek V4-kodningsprestanda sägs få cirka 81 % på SWE-bench Verified, upp från V3:s 69 %, även om oberoende verifiering inte har skett ännu. Med ett kontextfönster på 1 miljon token kan modellen bearbeta hela kodbaser i ett enda pass.

- Långtidsminne: V4 är byggd kring Engrams minnesarkitektur, som skiljer faktaåterkallelse från aktivt resonemang. Interna riktmärken hävdar 97 % nål-i-en-höstack-noggrannhet i en skala med miljoner token.

- Multimodal: Till skillnad från tidigare DeepSeek-modeller som endast var text, integrerar V4 text, bild och video under förträning, inte som ett tillägg.

Även med denna utveckling finns det fortfarande ingen DeepSeek-aktie tillgänglig på större börser som NASDAQ eller NYSE. DeepSeek är en privat kinesisk AI-startup, helt finansierad och ägd av High-Flyer, en kinesisk kvantitativ hedgefond. Den har ingen offentlig notering och har inte tillkännagett några planer på en sådan.

DeepSeek V4 Förväntad prissättning

V4 förväntas kosta 0,30 USD per miljon inmatade tokens och0,50 USD per miljon utmatade tokens . Det är något högre än V3.2 men fortfarande långt under GPT och Claudes priser för sina flaggskeppsmodeller. DeepSeek AI-chattplattformen förblir gratis för enskilda användare.

Tekniken bakom DeepSeek V4

Bakom allt som DeepSeek V4 lovar finns det en uppsättning arkitektoniska uppgraderingar som gör det möjligt.

1. MODELL1 Arkitektur

Rapporter tyder på att MODEL1 är det interna kodnamnet för V4. Den kombinerar mHC-träningsramverket med en omdesignad nyckel-värde (KV) cache genom Engram-minnet. Resultatet är en biljonparametermodell som körs på hårdvara som skulle ha varit otillräcklig för mycket mindre modeller för några år sedan. Det bidrar till DeepSeek V4:s systemeffektivitet med en rapporterad 40 % minskning av minnesanvändning och 1,8 gånger snabbare slutledning genom Sparse FP8 Decoding.

2. Gles FP8-avkodning

V4 körs på FP8 som standard, vilket är ett lättare, snabbare bearbetningsformat . För uppgifter som kräver mer precision, som komplexa resonemang eller matematik, kan den automatiskt växla upp till FP16. Du kan göra vardagliga uppgifter snabbt utan att offra noggrannheten när insatserna är högre.

3. Engram minnesmodul

Om standard LLM:er vanligtvis har faktaåterkallelse och aktivt resonemang i samma neurala nätverk, delar engram upp dem. Resonemang stannar kvar på GPU:n för snabb bearbetning, medan faktalagring komprimeras och återkallas endast när det behövs .

4. mHC-optimerade restanslutningar

En av de stora anledningarna till att V4 kan skalas utan att öka kostnaderna är mHC. Det förbättrar hur information flyttas mellan lagren, med endast cirka 6,7 % extra träningskostnader. Som ett resultat får du enmer kapabel modell utan det kostnadssteg som du normalt förväntar dig i den här skalan . DeepSeek V4:s API-prissättning kan också förbli konkurrenskraftig trots sin storlek.

Del 3. Jämförelse av DeepSeek-modeller:R1, V3 och V4

Så, hur står sig DeepSeek V4 mot sina föregångare? Vi har lagt de tre modellerna sida vid sida för att göra det lättare för dig att se vad som faktiskt har förändrats under varje generation.

| R1 | V3 | V4 | |

| Parametrar | 671B totalt, 37B aktiva | 671B totalt, 37B aktiva | 1 biljon (uppskattat) |

| Kontextfönster | 128 000 tokens | 128 000 tokens | 1 miljoner tokens |

| Kodningsriktmärken | Jämförbar med OpenAI o1 | 69 % SWE-bench Verified | 81 % SWE-bänk Verifierad (uppskattad) |

| Resoneringsfunktioner | Ren kedja av tankeresonemang | Hybrid; resonemang destillerat från R1 | Hybrid; djupare långsammanhangsresonemang via Engram |

| Multimodal | Endast text | Endast text | Text, bild, video (native) |

| API-prissättning (ingång) | 0,55 USD/M tokens | $0,14–$0,28/M tokens | $0,30/M tokens |

Del 4. Hur du använder DeepSeek i ditt kreativa arbetsflöde

DeepSeek AI är inte bara en chatbot du ställer frågor om. Det kan ta en mycket större roll i hela din kreativa process, som att skapa innehåll och kodning, och ta på sig det tunga lyftet på de uppgifter som äter upp det mesta av din tid.

För skapande av innehåll

- Skapa strukturerade artiklar och skript: Ge DeepSeek ett ämne, en målgrupp och en grov riktning. Den returnerar ett strukturerat utkast med rubriker, flöde och samtalspunkter redan på plats. Ditt jobb är bara att förfina och lägga till din egen röst, inte att börja från en tom sida.

- Brainstorma idéer och konturer: Fastnat på var du ska börja? Mata in din breda idé i DeepSeek och be om vinklar, krokar eller konturvariationer. Det ger dig något konkret att reagera på, vilket nästan alltid går snabbare än att bygga från grunden.

Omvandla dina idéer till videor snabbare med Filmora

Om du är en kreatör med videor som ditt slutmål, para ihop DeepSeek med en AI-videoredigerare som Wondershare Filmora kan vara den perfekta kombinationen du kunde ha bett om. Filmora samlar både generations- och redigeringsfunktioner på ett ställe, så att manuset du nyss byggde i DeepSeek kan gå direkt i produktion.

Och medan V4:s inbyggda videofunktioner fortfarande är oavgjorda, fyller Filmora det gapet idag. Några av Filmoras funktioner som kan hjälpa ditt arbetsflöde är:

- Skript till video:Tar ditt skrivna manus och förvandlar det automatiskt till ett videoutkast, med bilder, pacing och klipp inkluderade. Mata det manuset som DeepSeek AI just skrev och Filmora sköter resten.

- Text till video:Utgår du från en grov idé snarare än ett färdigt manus? Skriv in en prompt och Filmora genererar en kort video direkt från den som du kan förfina och bygga vidare på i dess flerspårstidslinje.

Du kan också hitta fler verktyg och funktioner, eller använda Filmoras AI Mate-redigering som din assistent som guidar dig genom redigeringar, genererar idéer och hanterar små uppgifter åt dig. Eftersom den är inbyggd i en videoredigerare stannar hela processen på ett ställe, så att du kan gå från idé till slutlig export.

Säker nedladdning

Säker nedladdning

För kodning och utveckling

Med bättre minne för långa sammanhang och starkare benchmarkresultat kan vi också se DeepSeek V4 som ett billigare alternativ till Claude när det gäller kodningsförmåga. Dess förmågor kan direkt stödja ditt utvecklingsarbetsflöde inom några nyckelområden:

- Felsökning och kodgenerering :Klistra in din trasiga kod med en beskrivning av vad den ska göra. DeepSeek identifierar problemet, förklarar det och returnerar en korrigerad version. Om du arbetar med en ny kod kan du också beskriva funktionen du behöver och låta den skriva ett fungerande första utkast.

- Arbeta med stora kodbaser: V4:s 1 miljon token-kontextfönster innebär att du kan ladda flera filer samtidigt och be DeepSeek att spåra buggar över beroenden, förklara hur komponenter interagerar eller omstrukturera en modul med hela kodbasen i åtanke.

- Automatisera repetitiva uppgifter: DeepSeek kan skriva skript för uppgifter som du upprepar manuellt, som filorganisation, dataformatering, rapportgenerering, API-anrop. Beskriv vad du gör och det returnerar något användbart vid första passet för det mesta.

Del 5. Hur DeepSeek kan jämföras med andra AI-modeller

Från de läckor vi känner hittills är det så här vi kan förvänta oss att DeepSeek V4 ska jämföras med andra AI-modellers flaggskeppsversioner från och med 2026.

| DeepSeek V4 | GPT-5.4 | Gemini 3.1 Pro | Claude Opus 4.6 | |

| Öppen källkod | ||||

| Resoneringsförmåga | Starkt med Engram-minne som förbättrar långa sammanhangsresonemang | 92,8 % GPQA | 94,3 % GPQA | 91,3 % GPQA |

| Agentisk kodning | ~81% SWE-bänk Verifierad (uppskattad) | 80 % SWE-bänk Verifierad | 80,6 % SWE-bänk Verifierad | 80,8 % SWE-bänk Verifierad |

| Kontextfönster | 1 miljoner tokens | 272K tokens (Standard); 1M tokens (Codex) | 1 miljoner tokens | 1 miljoner tokens |

| Indata (per 1 miljon tokens) | 0,3 USD | 2,5 USD | $2 | 5$ |

| Utdata (per 1 miljon tokens) | 0,5 USD | 15 USD | 12 USD | 25 USD |

| Bäst för | Kostnadskänsliga API-arbetsbelastningar, kodning, flexibilitet med öppen källkod | Mångsidighet, datoranvändning, kunskapsarbete | Resonemang på doktorandnivå, forskning, pris-prestanda | Komplex kodning, agentarbetsflöden, företag |

| Ekosystem | Öppen källkod, självvärd | Största tredjepartsintegreringarna | Djup Google Workspace-integrering | Starka utvecklarverktyg (Cursor, Claude Code) |

På råa benchmarksiffror ligger alla fyra modellerna närmare än vad marknadsföringen antyder, inom 1–2 procentenheter på både resonemang och kodning. Skillnaderna beror främst på kostnader och flexibilitet.

Specifikt i DeepSeek vs ChatGPT-matchningen är klyftan mest synlig i prissättningen. DeepSeek V4 är ungefär 8 gånger billigare än GPT-5.4 för liknande kodningsprestanda. ChatGPT leder fortfarande när det gäller ekosystemstorlek och mångsidighet, men DeepSeek stänger kvalitetsklyftan avsevärt samtidigt som kostnaderna hålls låga.

Del 6. DeepSeek V4 Reddit och community-reaktioner

DeepSeek V4 kanske inte är ute än, men en snabb sökning efter DeepSeek V4 på Reddit visar att utvecklargemenskapen har dissekerat det i månader, med r/DeepSeek har för närvarande 65 000 besökare per vecka.

De flesta reaktioner visar på spänning, medan andra förblir skeptiska till att DeepSeek V4-nyheterna är så lovande som läckorna gör det till. När allt kommer omkring går de flesta av de allmänt citerade benchmarksiffrorna tillbaka till ett raderat Reddit-inlägg (inklusive 81 % SWE-bench-poäng) och en overifierad tweet, inte en officiell DeepSeek V4-tidning eller oberoende testning.

Men om de gör det kan DeepSeek V4 bli den mest kapabla modellen med öppen källkod som finns tillgänglig till ett pris som gör alla andra gränsmodeller svårare att motivera.

Slutsats

Vi har brutit ner allt om DeepSeek V4. Modellen har ett lovande fall för att utmana jättar med sluten källkod och hjälpa dig att arbeta med dina projekt till en bråkdel av kostnaden. Men tills mer officiell information kommer ut, behandla allt du har läst här om V4 som ett lovande ledarskap, inte ett bekräftat faktum än.

Vanliga frågor

-

När kommer DeepSeek V4?

Den senaste uppskattningen av släppdatumet för DeepSeek V4 pekar mot april 2026. Tidigare spekulerades i ett tidigare fönster, men släppet har sedan dess försenats på grund av vad som enligt uppgift är felet i Huawei Ascend 910B-hårdvaran under träningen, vilket tvingade en arkitekturpivot tillbaka till NVIDIA GPU:er.

-

Vad skiljer DeepSeek V4 från V3?

Flera viktiga uppgraderingar som skiljer V4 från V3 är ett hopp från 128K till ett 1 miljon tokens kontextfönster, inbyggt multimodalt stöd och en ny Engram-minnesarkitektur som skiljer faktaåterkallelse från aktivt resonemang. Den skalar också upp till en biljon parametrar samtidigt som slutledningskostnaderna hålls låga genom Sparse FP8-avkodning.

-

Är DeepSeek V4 bättre än ChatGPT?

På råa benchmarks ligger V4 och GPT-5.4 inom ett par procentenheter från varandra på både resonemang och kodningsuppgifter. Där DeepSeek går framåt är kostnaden. V4 beräknas vara ungefär 8 gånger billigare per token. Men eftersom DeepSeek V4 inte har släppts ännu är det lite svårt att ringa ett definitivt samtal.

-

Kan du använda DeepSeek V4 gratis?

DeepSeek-chattplattformen förväntas förbli gratis för enskilda användare, som den har varit med tidigare versioner.