Om du tittade på lanseringsvideorna på Adobe MAX 2020 märkte du förmodligen några trender som bildades under produktdemos.

Mobilt och socialt var (och kommer alltid att vara) fokuspunkter, men artificiell intelligens (AI) och maskininlärning (ML) – eller Sensei som Adobe har valt att varumärket dem – tog scenen på ett antal överraskande sätt.

Som alltid gavs mycket av sändningstiden över till Photoshop, som lade till en bunt Sensei-drivna verktyg som heter Neurala filter som inkluderar bilduppskalning, himmelsbyte och porträttåldring. Men även om det är roligt att vrida fram klockan i ansiktet, och att byta ut den utblåsta silhuetten med en vanlig solnedgång gör landskapet vackrare, men det är svårt att se mycket kommersiellt värde i dessa verktyg. För det bör du titta på den minst omtalade AI-funktionen i Premiere Pro—tal-till-text.

Låt oss ta en titt på varför du kanske vill ha det, hur du kan använda det och om detta maskininlärningsverktyg kan öka din produktivitet eller inte.

Vi pratar inte om det

Låt oss ta en stund för att komma ihåg att detta inte är Adobes första försök att släppa ett verktyg för att konvertera inspelat ljud till redigerbar text. Talanalys lades till i Premiere Pro redan 2013. Det var...inte bra.

När jag testade den då var den bästa beskrivningen för resultaten den gav ordsallad.

Men för att vara rättvis gällde det samma även för annan mjukvara på den tiden. Googles automatiska transkription för YouTube-videor var lika opålitlig. Som en kommentator uttryckte det "enligt min erfarenhet gör det ett så dåligt jobb att den tid det skulle ta mig att rätta till det är betydligt mer än den tid det skulle ta mig att transkribera det själv."

Och det, i ett nötskal, var problemet. Så det var egentligen inte förvånande att Adobe drog ut Speech Analysis från offentlig utgivning 2014 och förblev tyst om saken tills den fantastiska Jason Levine tog den tillbaka i rampljuset 2020.

Olika slag

Motivationen för att automatiskt generera bildtexter beror troligen på ditt affärsperspektiv.

Till exempel vill företag som Google och Facebook ha det eftersom det gör video indexerbar och sökbar, vilket gör att vi kan hitta innehåll i videor (och för dem att sälja annonsplatser baserat på sammanhanget).

Men för videoproducenter och distributörer kommer behovet av bildtexter förmodligen från en annan plats.

Tillgänglighet

Lagarna kring tillgänglighet är olika över hela världen, men det närmaste vi har en global standard är Web Content Accessibility Guidelines (WCAG) publicerade av World Wide Web Consortium (W3C). Det är värt att notera att avsnitt 7.3 i den nuvarande WCAG anger att media utan bildtexter anses vara ett kritiskt fel som automatiskt misslyckas i klassificeringsprocessen.

I USA har FCC redan gjort det till ett juridiskt krav att allt TV-innehåll som sänds i Amerika måste vara textad, och varje efterföljande streaming av detta innehåll faller under samma regler.

Och även om det är sant att innehåll som unikt sänds över Internet faller utanför dessa regler, har lagstiftning inklusive Americans with Disabilities Act (ADA) redan använts framgångsrikt som grund för stämningar mot streamingplattformar som Netflix och Hulu.

Så nuförtiden är det förmodligen säkrare att anta att textning krävs enligt lag i det land/stat där du är verksam än att ta reda på den hårda vägen.

Sociala medier

Att uppfylla tillgänglighetskraven är en utmärkt motivering för textning, men det är också fördelaktigt för publik som inte lider av hörselnedsättning, särskilt när det kommer till video i sociala medier.

Dämpad autouppspelning håller snabbt på att bli normen för video i rullande sociala flöden, och det uppskattas att så mycket som 85 procent av videovisningarna sker med ljudet avstängt. Så om du vill förbättra signal-brusförhållandet för ditt sociala medieinnehåll är bildtexter nu en viktig del av processen.

Global räckvidd

Och för de av oss som arbetar med globala marknader har det länge varit känt att bildtexter är det enklaste sättet att återanvända ditt film- och videoinnehåll för publik som talar ett annat språk. (Säkert mycket mindre involverad än dubbning och ADR.)

Även om vissa översättningstjänster kan arbeta direkt från originalmediet, kan en bildtextfil på originalspråket hjälpa till att påskynda processen.

Det finns naturligtvis andra anledningar till att bildtexter snabbt blir en viktig komponent i medieproduktion, och det är inte bara på grund av memes.

Men även om behoven kan förändras från företag till företag, är den grundläggande fördelen densamma – genom att texta dina media hjälper dig att nå en större publik. Och det är bra för alla .

Låt oss börja showen

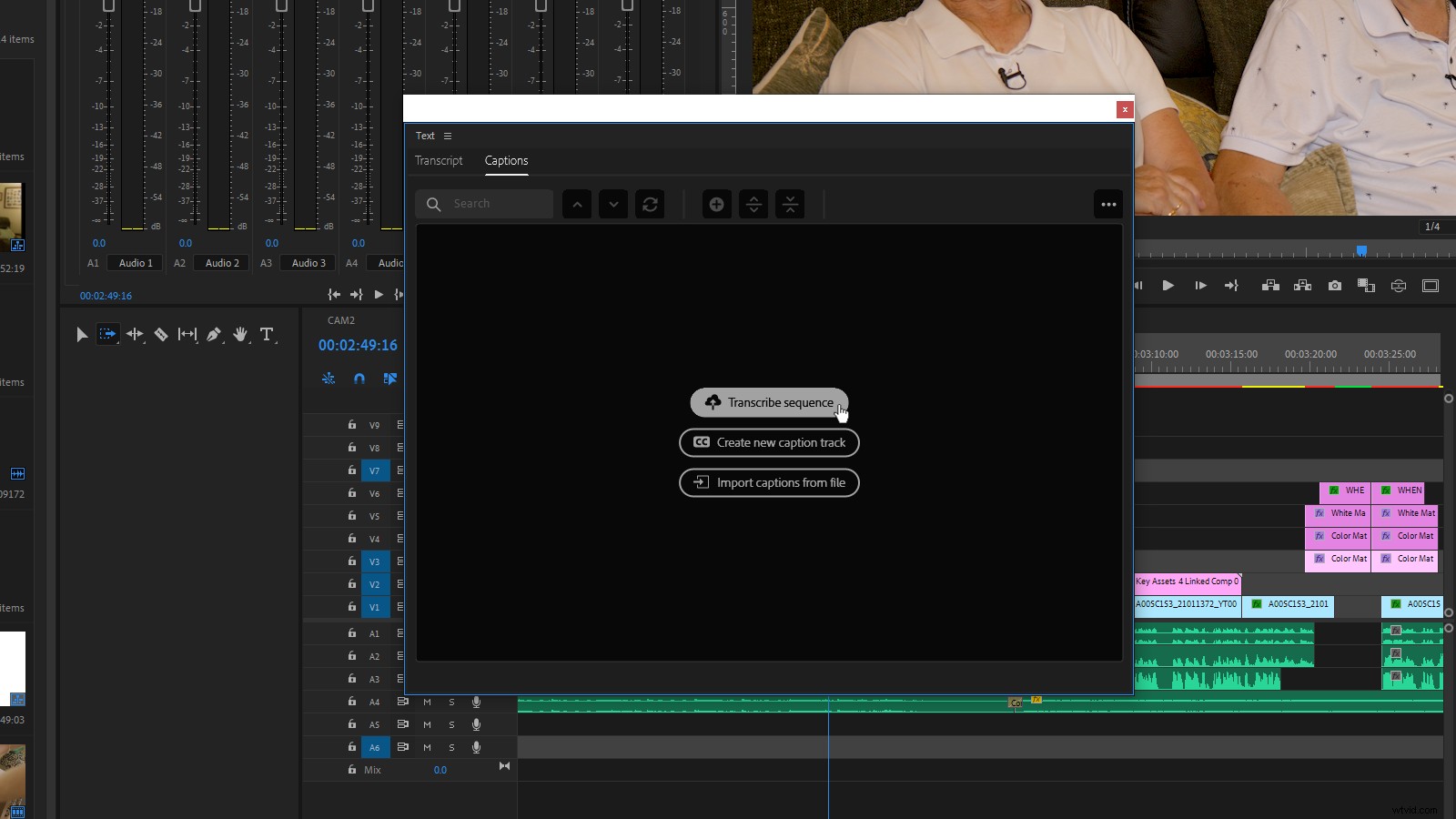

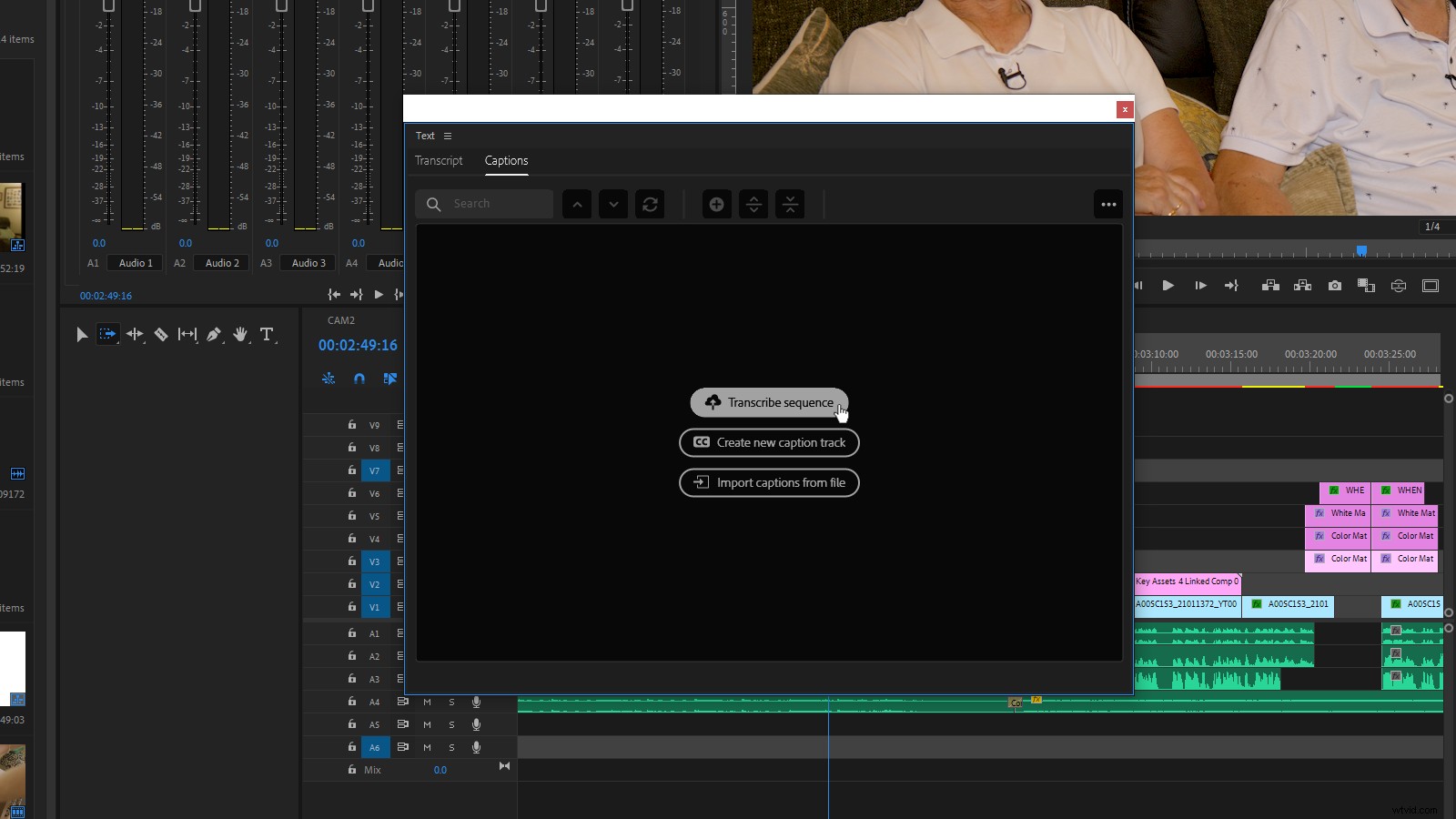

För att komma igång öppnar du projektet som ska textas i Premiere Pro och har målsekvensen aktiv i tidslinjevyn.

Beroende på hur du har strukturerat din redigering kan en liten förberedelse vara fördelaktigt innan du går vidare.

Till exempel, om du har lagt ut flera sång på separata spår, eller om du har en blandning av sång och SFX/musik på samma spår, bör du lägga lite tid på att tagga sångklipp som Dialog med hjälp av Essential Sound Panel (du kan också välja att stänga av alla oönskade spår på tidslinjen om det är lättare.) Detta kommer att låta Premiere Pro veta vilka tillgångar som ska inkluderas i det exporterade ljudet som den analyserar senare.

Dessutom, om du inte vill skapa bildtexter för hela sekvensen, bör du ställa in sekvens In- och Ut-punkter genom att flytta spelhuvudet till önskade positioner och trycka på I- och O-tangenterna. (Observera att arbetsområdesfältet inte används för den här funktionen.)

När du är redo öppnar du textfönstret (Fönster->Text) och trycker på Transkribera sekvensen knappen.

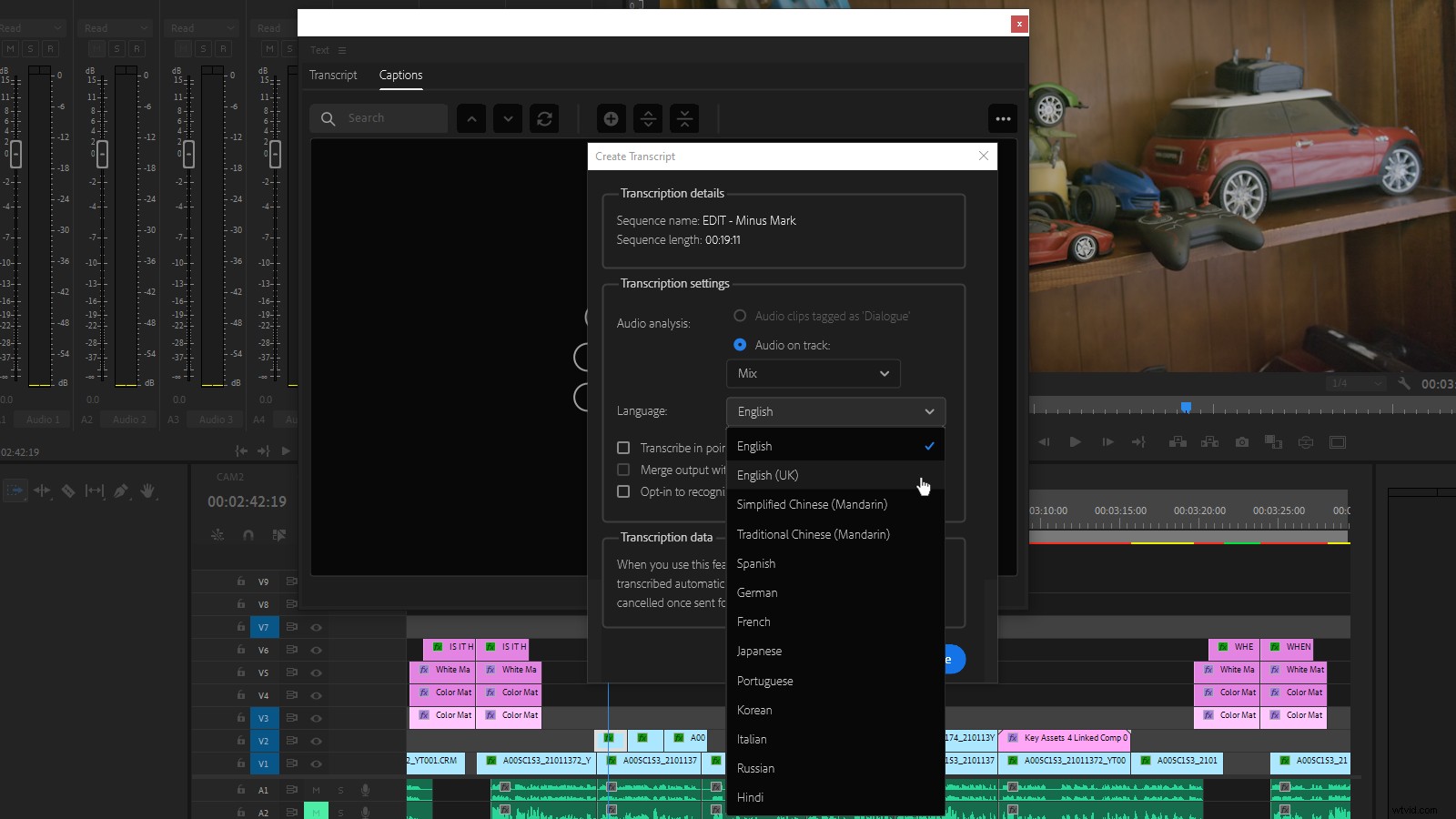

Dina alternativ vid denna tidpunkt är enkla. Du kan välja att exportera en mixdown av bara de klipp du har taggat som Dialog, du kan välja Mix för att skapa en mixdown av hela sekvensen, eller så kan du välja ett specifikt spår att exportera från rullgardinsmenyn.

För närvarande finns det inget sätt att välja flera ljudspår för mixningen, vilket kan vara jobbigt om du har flera högtalare på separata spår. För tillfället är det bara att stänga av de spår du inte vill inkludera och välja alternativet Mix.

Tal-till-text stöder ett imponerande urval av språk som täcker större delen av världens befolkning. Anmärkningsvärda undantag är arabiska, bengaliska och indonesiska, men det är intressant att se både amerikanska och brittiska varianter av engelska. (Som en brittisk ex-pat som bor i Australien, får den senare bonuspoäng hos mig.) Jag kan dock bara kommentera effektiviteten av verktyget på engelska.

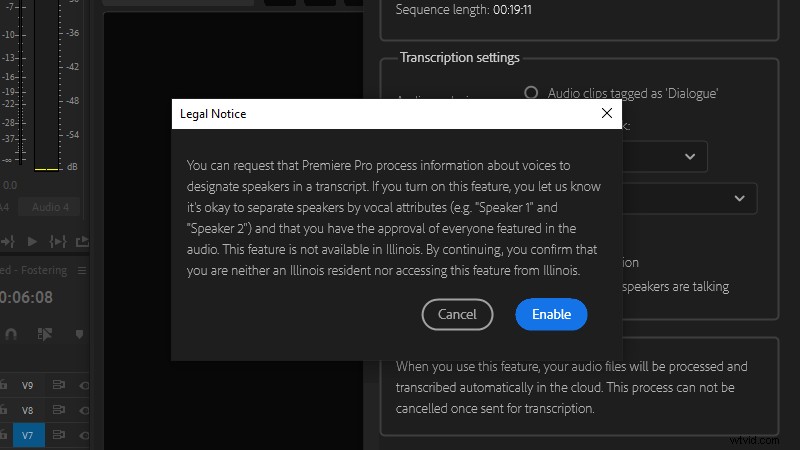

Det är intressant att notera att Senseis förmåga att identifiera olika talare – vilket var standardbeteendet i betaversionen – nu kräver samtycke och är inte tillgänglig i Illinois, förmodligen på grund av integritetsproblem.

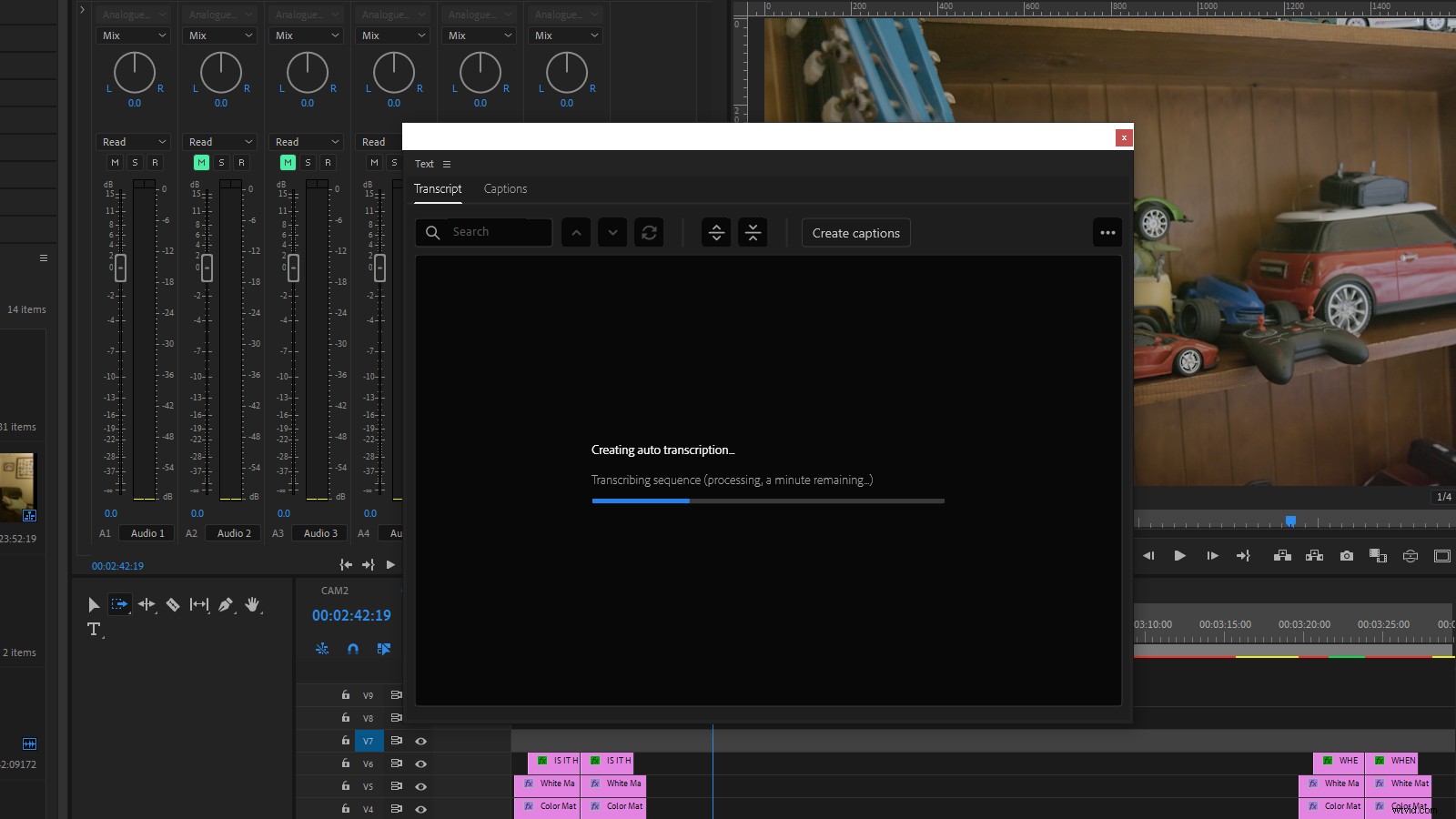

Transkriptionsprocessen är relativt snabb, med ett fyra minuters testprojekt med dubbla högtalare som tar cirka två minuter och en timslång sekvens som tar 24 minuter, vilket indikerar en omloppstid på ungefär halva körtiden.

Men Speech-to-Text är (för det mesta) molnbaserat och det är omöjligt att förutsäga vilka hastigheter som kan bli om hela Adobe Creative Cloud-medlemskapet plötsligt börjar tugga upp Senseis beräkningscykler samtidigt. Som sagt, även om det blir nödvändigt med jobbköer, kommer du och din arbetsstation åtminstone att vara fria att brygga det där kaffet eller hinna med andra uppgifter under tiden.

Kom tillbaka till jobbet

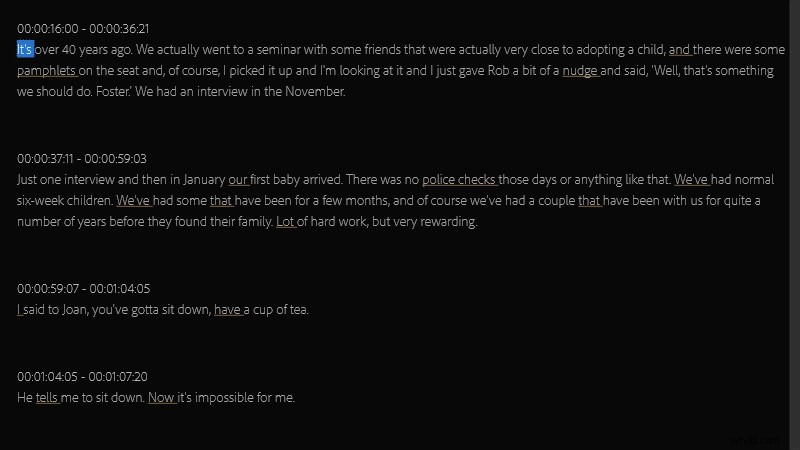

När Sensei är klar med ditt ljud fylls fliken Transcript i textpanelen med resultaten.

Och även om din körsträcka kan variera, måste jag säga att jag var imponerad av noggrannheten i testerna jag körde. Betaversionen som jag först testade var bra – den offentliga versionen är ännu bättre.

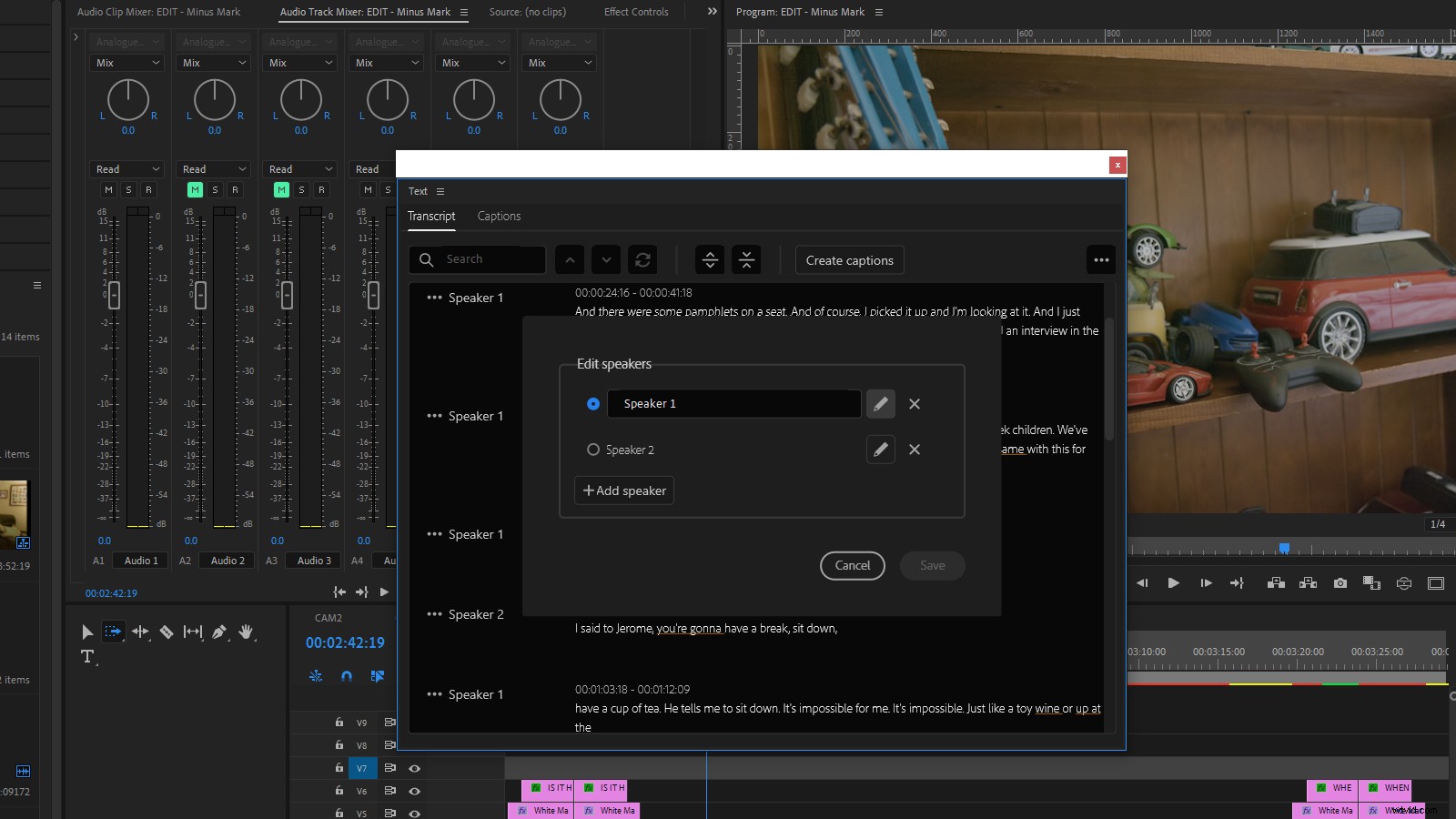

Genom att välja högtalarprofilering känner Sensei igen flera högtalare och identifierar dem som högtalare 1, högtalare 2, etc. Om du väljer bort det kommer det helt enkelt att lista Okänd bredvid styckesegmenten.

Oavsett vilket kan du namnge dem genom att klicka på ellipsen i den vänstra kolumnen på fliken Avskrift och välja Redigera högtalare.

Med det här verktyget kan du manuellt åtgärda fall där Sensei kan ha felaktigt identifierade högtalare med liknande röster, och det är värt att ta dig tid att göra detta nu innan du går vidare till skapandet av bildtexter.

Detsamma gäller för utskriftsrensning. Om du inte har haft mycket tur med din tal-till-text-analys kommer det att finnas fel i din utskrift. Dessa är mer sannolika i inspelningar med en mer konversationspresentation, bakgrundsljud, icke-ordboksord som företagsnamn eller flera talare som pratar över varandra.

Och även om du kommer att kunna redigera texten efter att den har konverterats till bildtexter, bör du korrigera avskriften innan du kommer till nästa steg. Detta beror på att Premiere Pro behandlar transkriptionen och efterföljande bildtexter som separata datakällor – så att ändringar i den ena inte har någon effekt på den andra.

Så ta dig tid att få din transkription rätt eftersom det kommer att vara källan från vilken alla dina bildtexter kommer att skapas.

Ta sig runt

Adobe har implementerat några extremt användbara funktioner som hjälper dig att navigera i videon och utskriften samtidigt.

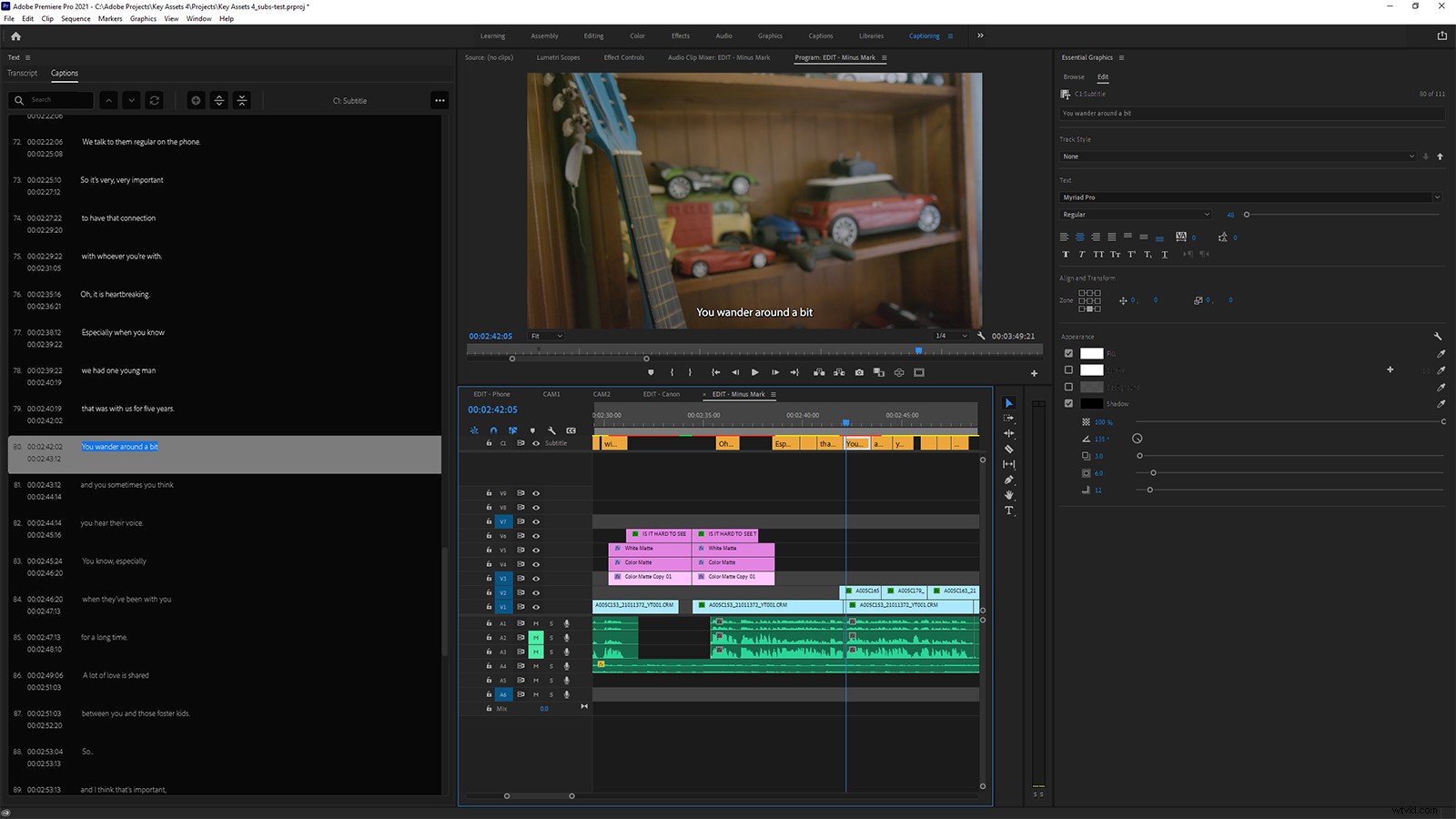

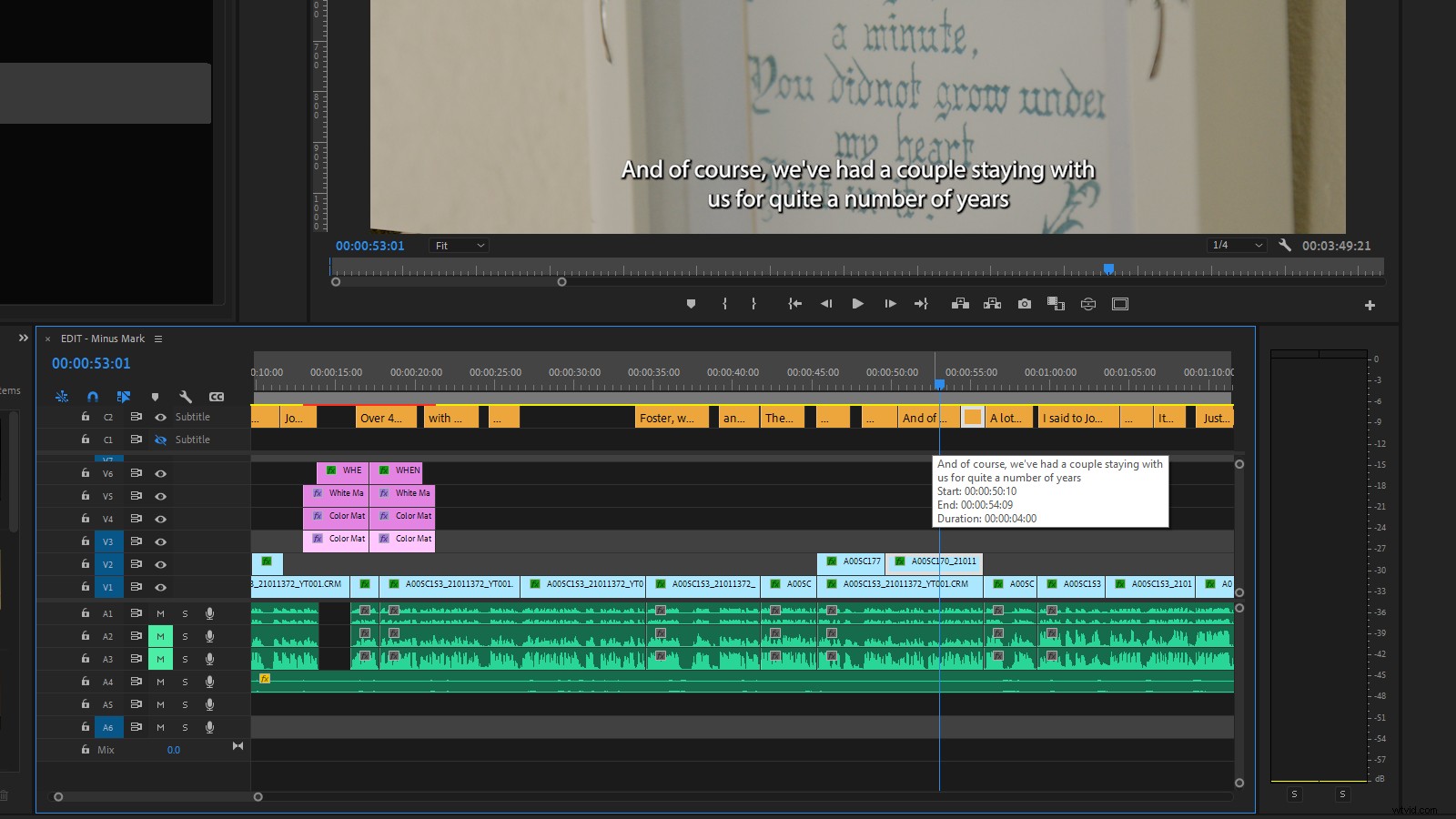

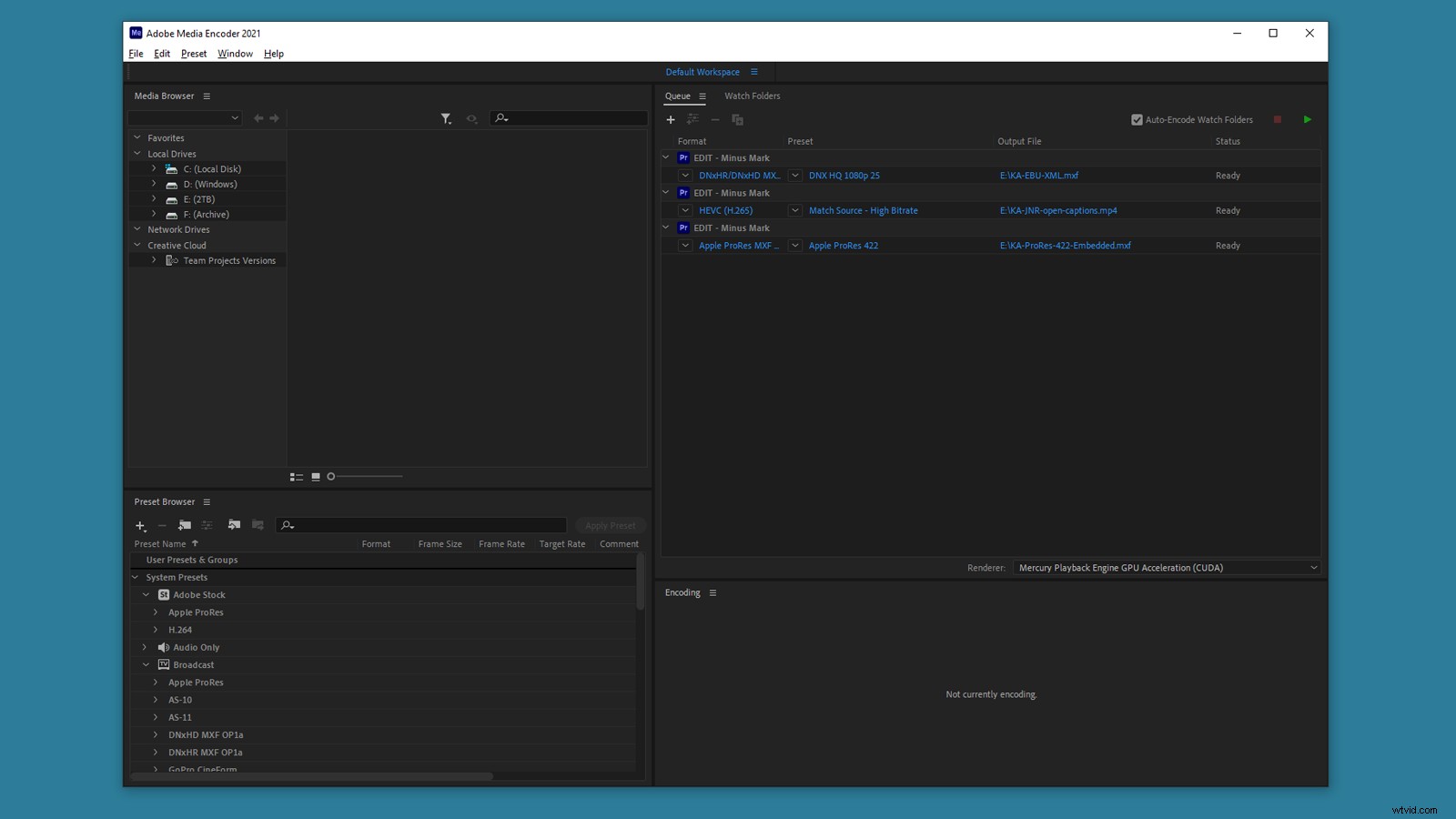

Till att börja med har Premiere Pro redan en Captions-arbetsyta som delar upp din skärm i Text, Essential Graphics, Timeline, Project Bins och Program. Även om du kanske vill justera saker så att de passar dina önskemål. För mig ser det ut så här...

När du väl är klar är det enkelt att hitta rätt.

Om du t.ex. flyttar spelhuvudet till en ny position på tidslinjen kommer transkriptet automatiskt att hänvisa till motsvarande plats, i den utsträckning som ordet som talas vid den punkten under spelhuvudet är blåmarkerat i transkriptionspanelen. All text som ligger före spelhuvudets position är färgad grå, vilket är ett användbart tillägg till UX.

På liknande sätt uppdateras transkriptionsvyn för att hålla jämna steg med spelhuvudet genom att spela eller skrubba tidslinjen.

Och det fungerar även omvänt, så om du väljer ett ord i transkriptionspanelen flyttas spelhuvudet och videoförhandsvisningen automatiskt till motsvarande tidpunkt i sekvensen. Det kan vara lite långsamt att svara ibland – möjligen för att det pratar med Adobes servrar – men det är ändå ett mycket effektivt tillvägagångssätt.

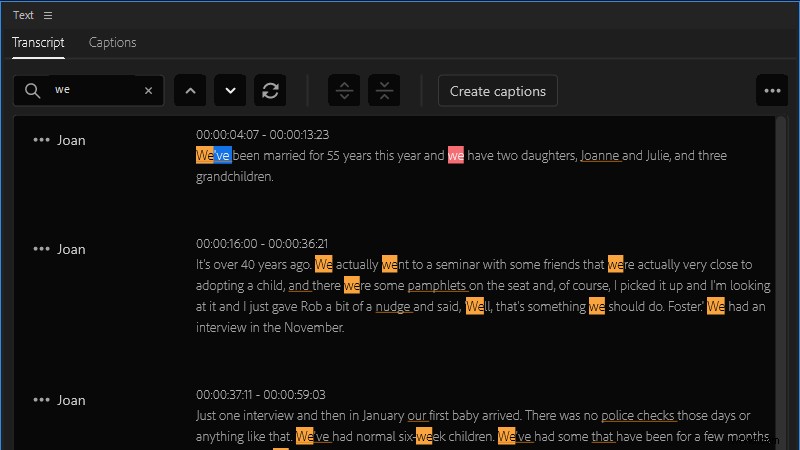

Det finns också en sökruta i det övre hörnet, som låter dig gå till ord och fraser i utskriften, samt en Ersätt-funktion om du skulle behöva åtgärda upprepade fel.

Bästa praxis

I det här skedet kommer du förmodligen att göra det mesta av din navigering i transkriptionspanelen; välja ett ord, trycka på blanksteg för att starta uppspelningen, jämföra det du hör med det du läser, sedan stoppa och dubbelklicka på texten för att göra ändringar.

Baserat på min erfarenhet kommer dina ändringar troligen att fokusera på skiljetecken och meningsstruktur, snarare än att fixa felaktiga ord. Och trots Senseis bästa ansträngningar måste du fortfarande anstränga dig för att få saker och ting till ett bildtextningsläge.

Och detta är att vänta. Naturlig språkbehandling är otroligt hård. När du har räknat in accenter, dialekt, manér, tonfall och betoning, kämpar även människor med det. Så att förvänta sig perfekta resultat från en maskin är orealistiskt. (Jag rekommenderar starkt att du aktiverar YouTubes automatiska textning för följande videoexempel.)

(Detta är ett bra alternativ – https://youtu.be/Gib916jJW1o)

Så gå till det här stadiet med ett öppet sinne, en ny kopp kaffe och en bekväm stol. Och om du behöver vägledning om bästa praxis för att skapa bildtexter, kanske du vill läsa igenom BBC:s riktlinjer för undertexter först.

Kom också ihåg att transkriptionsdata sparas i Premiere Pro-projektfilen, så att du kan komma tillbaka till den senare om du behöver. Du kan också exportera transkriptet som ett separat, men proprietärt .prtranscript fil, även om det inte är klart vad fördelen med detta tillvägagångssätt kan vara.

Klar du?

När du är säker på att din utskrift är så ren som du kan göra den, fortsätt och tryck på Skapa bildtexter knappen.

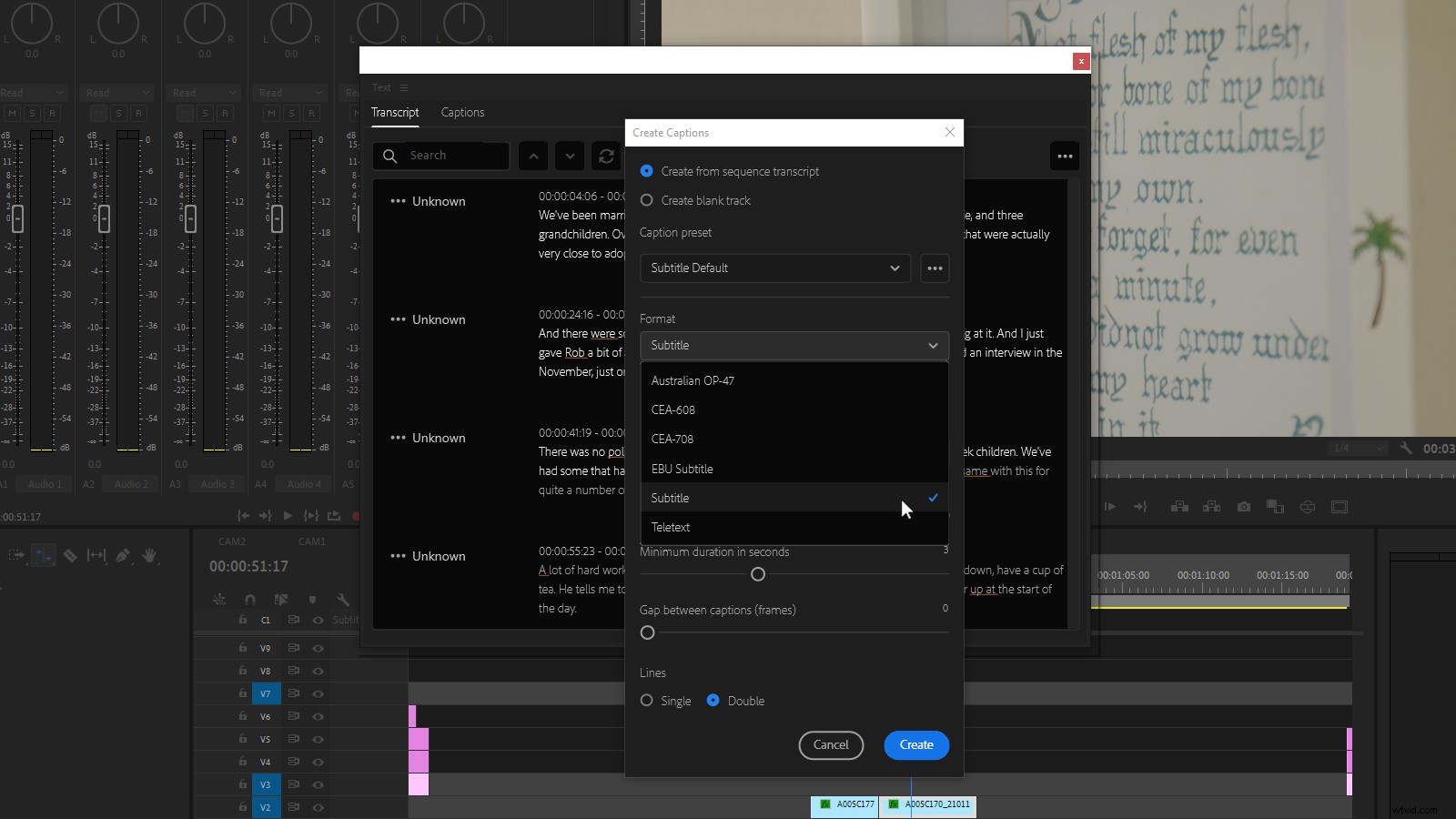

Du kommer att få ett gäng alternativ här, inklusive möjligheten att tillämpa stilar (förutsatt att du tidigare har skapat några). Du kan definiera maximal teckenlängd och minsta varaktighet för dina bildtexter, ställa in dem på Dubbel eller Enkel rad och till och med antalet ramar du vill infoga mellan dem.

Om du inte är säker på vad du vill ha i det här skedet, föreslår jag att du väljer "Undertext"-formatet från rullgardinsmenyn, se till att Skapa från sekvensavskrift alternativknappen är vald och lämna resten på sina standardvärden.

Jag tänker inte spendera mycket tid på att diskutera de olika bildtextformaten som Speech-to-Text erbjuder. Dels för att jag inte är expert på skillnaderna, och du kommer att känna till dina projektkrav bättre än jag. Men mest för att det inte spelar så stor roll .

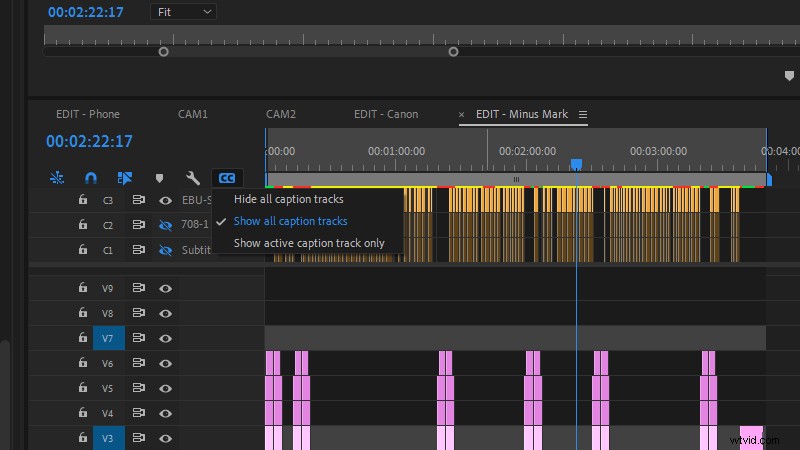

Detta beror på att Premiere Pro's Speech-to-Text håller dina transkriptionsdata intakta och lägger till dina bildtexter i ett separat spår i sekvenstidslinjen. (Detta är en enorm förbättring jämfört med Premiere Pros första försök med bildtexter, som inkorporerade bildtextspåret i videolagret.)

Tack vare detta kan du generera bildtexter i så många olika format du behöver. Även retroaktivt, om ditt projekt skulle säljas till ett område som använder en annan standard. Det verkar inte finnas någon gräns för hur många textningsspår du kan lägga till, och formatet som används för varje textspår är tydligt märkt.

Om det börjar bli rörigt kan du växla spårsynlighet med CC-knappen i tidslinjevyn.

Om du arbetar med textning på främmande språk kan den här aspekten av användargränssnittet vara extremt användbar, eftersom den har potential att låta dig bygga bildtextlager för så många språk som du behöver i samma tidslinje . Det finns begränsningar för detta tillvägagångssätt, som jag kommer till senare, men av personlig erfarenhet välkomnar jag detta helhjärtat.

Så fortsätt och tryck på knappen Skapa, och se hur din utskrift är uppdelad och läggs ut i det format du väljer.

Ännu en omgång

Om du har någon erfarenhet av att skapa bildtexter vet du att bra bildtexter kräver en överraskande mängd finess.

Det är inte så enkelt som att dela upp dialogen i meningar och visa dem på skärmen så länge som det tar talaren att säga dem.

Du måste dekonstruera det som talas till korta, begripliga avsnitt som kan läsas utan att dra för mycket uppmärksamhet från det visuella. Skiljetecken är otroligt viktigt, och radbrytningar kan betyda skillnaden mellan förståelse och förvirring. Och för att vara rättvis verkar Speech-to-Text göra ett rimligt jobb med detta.

Men för att följa textningsstandarder som FCC:s måste du förmedla brus och musik i största möjliga utsträckning . Och även om det är orimligt att förvänta sig att Sensei ska börja märka ljud och musik (åtminstone för närvarande), bör din textningsprogram tillåta dig att införliva information bortom dialog.

En i taget, tack

Tyvärr är Speech-to-Text begränsad till en enkel spår utan utrymme för överlappande element.

Detta innebär att det inte finns något sätt att enkelt integrera samtidiga högtalare eller lägga till ljud- eller musikidentifierare över dialog. (Jag försökte lägga till dessa i ett andra bildtextspår, men du kan bara aktivera synlighet för ett spår åt gången.)

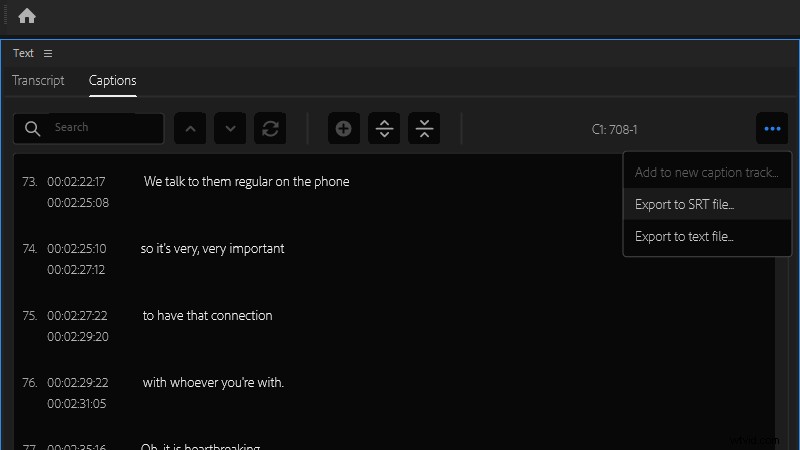

Så om FCC-efterlevnad behövs för ditt projekt, kan du behöva lämna över det här jobbet till en annan bildtextlösning. Men även då kan du fortfarande använda Speech-to-Text för att få dig det mesta, och sedan exportera resultaten till en text- eller SRT-fil (SubRip) för import till ett annat verktyg.

Dela skillnaden

När du väl har börjat redigera bildtexterna som genereras av Speech-to-Text, är Premiere Pros arbetsflöde mycket vettigt.

Meningarna är uppdelade i korta enradiga segment som passar även på de minsta skärmarna utan radomslutning. Och du kan välja att slå samman eller dela upp dessa ytterligare om de inte riktigt fungerar i deras nuvarande tillstånd.

Det är också möjligt att lägga till nya bildtexter, förutsatt att det finns utrymme att göra det (standardinställningen för den infogade bildtexten är tre sekunder, och du kan sluta skriva över befintliga bildtexter om du inte är försiktig här).

Bildtexter beter sig också som alla andra tillgångar på tidslinjen. Så du kan justera deras in- och ut-punkter genom att dra klipphandtagen, länka dem till videoklipp, dela dem med Razor-verktyget eller till och med utföra slip-, slide-, rippel- och rollredigeringar.

Så om du redan känner till Premiere Pro-verktygsuppsättningen, kommer dina befintliga kunskaper att stå dig väl till pass här.

Åtgärdar det i post-post

Det finns dock en begränsning för spårredigering som är unik för bildtexter.

Även om du kan välja och manipulera flera video-, ljud- eller bildspår samtidigt, kan bara ett bildtextspår vara aktivt när som helst. Om du behöver justera flera textspår i olika format måste du göra det ett spår i taget.

Men det här känns som att klyva hårstrån. Med tanke på att textningsprocessen vanligtvis äger rum långt efter att redigeringen är låst och godkänd, bör göra ändringar i flera bildtextformat vara ett randscenario.

Öppna eller stängda?

Premiere Pro erbjuder ett brett utbud av formateringsverktyg för dina bildtexter, inklusive möjligheten att spara stilar och tillämpa dem på framtida projekt.

Du kan justera teckensnitt, färg, skugga, konturer och bakgrundsalternativ, såväl som position, textjustering och användbart bildtextområde. Och dessa kan tilldelas individuella bildtexter, eller över hela bildtextspåret.

Dold textning

Men i vilken utsträckning du kan ändra utseendet på dina bildtexter beror på om du tänker distribuera dem som öppna eller stängd .

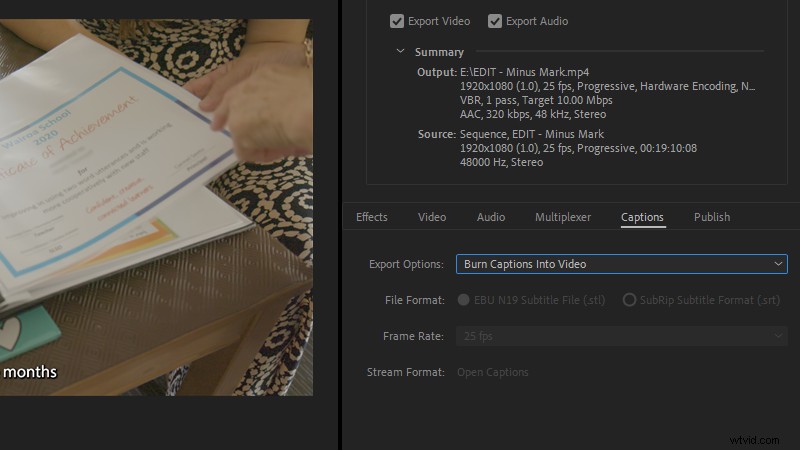

Dold textning lagras som separata filer – även känd som sidvagnsfiler – och kan aktiveras och stängas av av tittaren under uppspelning.

Det mesta av formateringen för dold bildtext hanteras av uppspelningssystemet, så formateringsalternativen är begränsade (och Premiere Pro visar bara funktioner som stöds av ditt valda bildtextformat). Men trots namnet är textning lättare att ändra efter att ha färdigställts eftersom de vanligtvis är en enkel text- eller XML-fil.

Öppen textning

Däremot "bränns öppna texter in" i videon, så de är alltid synliga (oavsett uppspelningsplattform eller enhet) och du kan formatera dem hur du vill.

Det betyder också att du kan skapa en enda version av den undertextade videon som kommer att spelas upp på alla videoplattformar.

Men avvägningen här är att dina bildtexter inte kan ändras utan att återrendera och distribuera hela videon. Och om du arbetar med flera språk måste du skapa helt nya videor för varje språk istället för en mer lätthanterlig uppsättning textningsspår.

Det är också värt att notera att öppen textning kommer att ändra storlek tillsammans med videon, så om din publik tittar på en bit av 16×9 media i stående vy på en mobil enhet, finns det en chans att din bildtext kan bli för liten för att läsas.

På grundval av detta kanske du tror att det inte finns någon övertygande anledning att välja öppen textning på ditt videoinnehåll. Men om du publicerar på sociala medier, kanske du inte vill lita på de automatiska textningsverktygen som för närvarande är ditt enda alternativ på plattformar som Instagram eller TikTok.

Vissa sociala plattformar tillåter dig bara att lägga till bildtexter samtidigt som du laddar upp videon, vilket gör det omöjligt att schemalägga eller automatiskt lägga upp videoinnehåll med bildtexter. Så öppen textning kan fortfarande vara ett genomförbart alternativ.

| YouTube | TikTok | ||||

| Ladda upp bildtexter | Y | Y | Y | Y | N |

| Auto-generate captions | Y | Y | N | N | Y |

| Schedule captioned video | Y | Y | N | N | N |

Avslutar

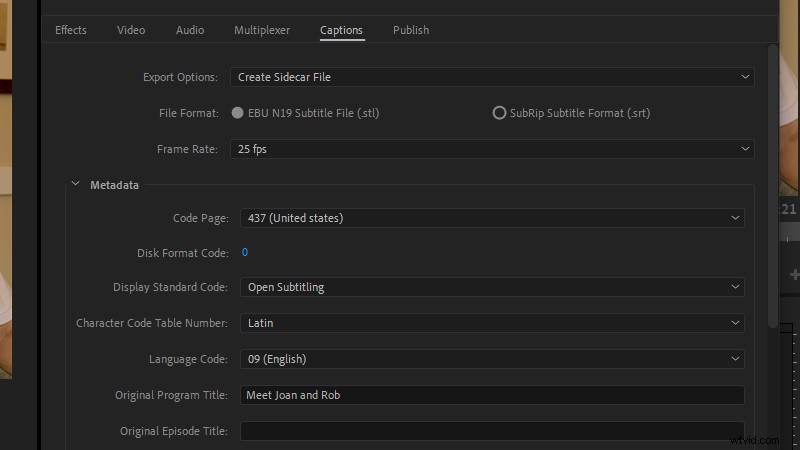

Om man tittar på den nuvarande versionen verkar det som om dina exportalternativ har reducerats till EBU N19 eller vanlig text SubRip SRT-fil – MacCaption VANC MCC-formatet och Bädda in i utdatafil alternativ som finns i betaversionen är inte längre tillgängliga.

Detta är dock inte så begränsande som det låter, eftersom EBU betjänar de flesta streaming- och sändningstjänster, och SRT täcker de flesta online- och sociala videoplattformar.

Vad vi inte ser är möjligheten att endast exportera bildtextspåret från Premiere Pros exportverktyg eller Adobe Media Encoder, så du måste rendera ut minst en ljudfil för att få en XML-textfil.

Med tanke på att du kan exportera till .srt- och .txt-filer från bildtextpanelen verkar detta konstigt och det verkar troligt att det kommer att ändras i framtiden.

Om du vill ha öppen bildtext kan du bara välja Bränn bildtexter till video alternativ. Och naturligtvis, om du vill skapa flera exporter i olika format, kan du köa dem i Adobe Media Encoder för batchexport. Se bara till att du ställer in det önskade bildtextspårets synlighet på tidslinjen först.

Vad saknas?

När jag testade betan noterade jag några områden där Adobe kan förbättra det här verktyget innan det släpps till allmänheten och, med ett litet undantag, "saknas de fortfarande". Så här är min önskelista:

- Justerbar teckenstorlek i panelerna Transkription och Bildtexter.

Textstorleken definieras för närvarande av systeminställningarna, och det finns tillfällen jag ville höja teckenstorleken för att göra det enklare att läsa medan du redigerar avskriften. - Skriptimport.

Om du arbetar med skriptmaterial kan Speech-to-Text i teorin hoppa över transkriptionsprocessen och fokusera på timing istället. Detta skulle tillåta dig att snabbt konvertera det du redan har till ett bildtext-färdigt format. (YouTube har redan detta.) - Anpassad formatering baserad på högtalare.

Även om du kan identifiera högtalarna i transkriptionen, finns det inget sätt att automatiskt lägga till den informationen i dina bildtexter. Och om du textar scen för scen kan det vara användbart att ha anpassad bildtextplacering för högtalare som alltid kommer att vara på en viss sida av bildrutan.

Men är det värt det?

Jag kan inte säga vad din erfarenhet av Premiere Pros Speech-to-Text kan vara.

Är det automatisering med en knapp för alla dina textningsbehov? Självklart inte. Och jag tror att vi fortfarande är långt ifrån att bygga ett system som kan hantera denna komplexa och oändligt varierande uppgift utan någon form av mänsklig inblandning.

Men för mig blev det här verktyget en standardinkludering i min verktygslåda innan den ens lämnade beta.

Om du trycker på skulle jag uppskatta att det har minskat tiden det tar att texta innehåll till ungefär en tredjedel av vad det var tidigare . It’s not the only option available—Otter.ai will export transcripts to the .srt caption format, Digital Anarchy has a Premiere Pro plugin called Transcriptive, and of course, you can pay companies to do the job for you—but all of these have a cost component, while Speech-to-Text is currently free to use.

It all comes back to that comment I included at the beginning of this article—is it easier to use Speech-to-Text than it would be to transcribe it yourself? For me, the answer is a very firm yes. So if you’re looking at finding a better way to add accessibility and greater audience engagement to your video projects, Premiere Pro Speech-to-Text is definitely worth a look.

(And if you’re looking for more content on working with audio in Premiere Pro, check out Premiere Pro Mixing Basics and Premiere Pro Audio Tools.)